億級數據湖統一存儲技術實踐 構建高效數據處理與存儲支持服務

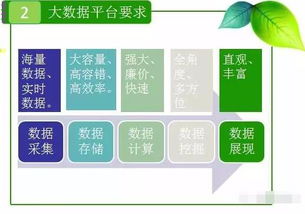

在當今數據驅動的時代,企業面臨著數據規模爆炸式增長、數據類型日益多樣化、數據處理需求實時化的多重挑戰。構建一個能夠容納并高效管理億級乃至更大量級數據的統一存儲平臺——數據湖,已成為眾多企業的核心戰略。本文將探討億級數據湖的統一存儲技術實踐,并重點闡述其如何為上層的數據處理與分析提供強大的存儲支持服務。

一、 數據湖統一存儲的核心理念與架構

傳統的數據倉庫模式因其嚴格的結構化要求和模式預定義,難以應對海量半結構化、非結構化數據以及快速變化的業務需求。數據湖應運而生,其核心理念是“先存儲,后定義”,即以原始格式(如Parquet、ORC、Avro、JSON、文本、圖像、音視頻等)集中存儲企業內所有類型的數據,而不預先施加模式限制。

一個典型的億級數據湖統一存儲架構通常包含以下層次:

- 存儲層:基于可擴展的對象存儲(如AWS S3、阿里云OSS、華為云OBS)或分布式文件系統(如HDFS)構建,提供海量、低成本、高可靠的底層存儲能力。這是數據湖的“湖盆”。

- 數據組織與元數據管理層:這是數據湖的“大腦”。通過統一的元數據服務(如Hive Metastore、AWS Glue Data Catalog、Apache Iceberg/Hudi/Deltalake的元數據表),對存儲在底層的大量文件進行編目、定義表結構、記錄數據版本、分區信息及訪問權限,使原始數據變得可發現、可管理、可治理。

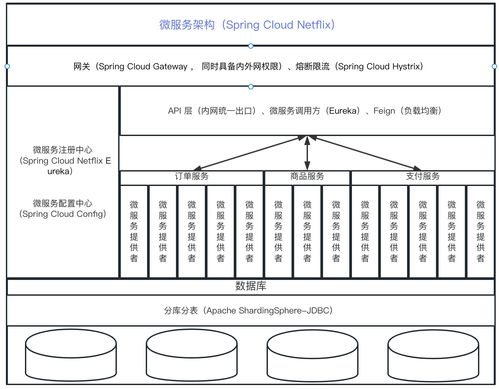

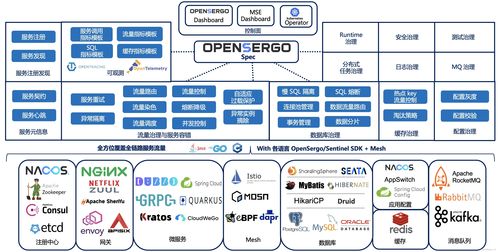

- 計算與處理層:各類計算引擎(如Spark、Flink、Presto/Trino、Hive)通過統一的連接器或接口,直接訪問存儲層的數據,并利用元數據層的信息進行高效的查詢和分析。存儲與計算分離是此架構的關鍵特征。

- 安全、治理與生命周期管理層:貫穿始終,提供統一的身份認證、權限控制、數據加密、數據血緣、質量監控及冷熱數據分層存儲策略,確保數據湖的安全、合規與成本可控。

二、 關鍵技術實踐:為數據處理提供堅實支持

1. 采用高性能列式存儲格式

對于大規模分析型負載,將原始數據轉換為Parquet或ORC等列式存儲格式至關重要。這類格式具有極高的壓縮比,能顯著減少I/O和存儲成本;其列式特性允許查詢引擎僅讀取所需列,大幅提升掃描效率,直接加速了上層的Spark SQL、Presto等查詢性能。

2. 實施精細化的數據分區與分桶策略

對海量數據按時間(如天、小時)、地域、業務維度進行分區,是提升查詢性能最有效的手段之一。分區能將全表掃描轉化為部分分區掃描。結合分桶(Bucketing)技術,可以進一步在分區內將數據散列到固定數量的文件中,優化JOIN操作和數據采樣。合理的分區策略是元數據管理的重要部分,直接服務于查詢優化。

3. 擁抱開源數據表格式(Table Format)

使用Apache Iceberg、Apache Hudi或Delta Lake等表格式,是構建現代數據湖的統一存儲實踐的核心。它們通過在元數據層提供ACID事務、時間旅行(快照查詢)、增量讀取、模式演進、并發控制等高級特性,將簡單的文件集合提升為“數據表”。這極大地簡化了數據處理流水線(如流批一體、CDC入湖)的構建,保證了數據的一致性和可靠性,為上層的計算引擎提供了穩定、高效的接口。

4. 構建統一的元數據與數據目錄服務

一個集中、統一的元數據目錄是所有數據處理任務發現和理解數據的基礎。它應該支持自動化的元數據發現與采集、業務術語標注、數據血緣追蹤和數據質量規則定義。強大的數據目錄使得數據分析師和數據科學家能夠快速找到所需數據,理解其含義和來源,這是數據湖發揮價值的前提。

5. 實現存儲與計算資源的彈性解耦與優化

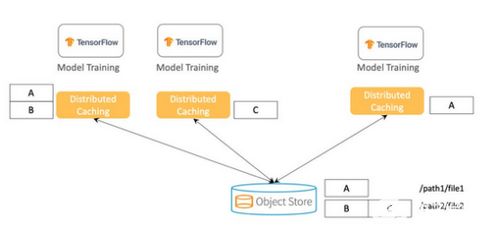

利用云上對象存儲的無限擴展性和按需付費特性,存儲層可以獨立于計算集群進行伸縮。計算資源(如Spark集群)可以根據處理任務的需要動態啟停和擴縮容,無需為存儲綁定昂貴的固定硬件。通過智能緩存(如Alluxio)將熱數據緩存在計算節點附近,可以彌補對象存儲可能存在的延遲短板,為交互式查詢提供加速支持。

三、 存儲支持服務的具體體現

統一的數據湖存儲平臺,為上層的數據處理提供了全方位的“支持服務”:

- 對批量處理的支撐:為大規模的ETL/ELT作業提供高吞吐量的數據讀取和寫入能力。優化的存儲格式和分區策略直接決定了批處理作業的運行效率與成本。

- 對流式處理的支撐:通過與流計算引擎(如Flink、Spark Streaming)及Kafka等消息隊列的集成,支持實時數據持續入湖。Iceberg等表格式的增量讀取和流式寫入能力,是實現流批一體架構的關鍵存儲基礎。

- 對交互式分析的支撐:為Presto/Trino、Impala等即席查詢引擎提供低延遲的數據訪問路徑。列式存儲、分區修剪、統計信息(由元數據管理)以及可能的緩存層,共同保障了亞秒級到秒級的查詢響應。

- 對數據科學與AI的支撐:以原始或預處理后的格式存儲非結構化數據(圖像、日志),并通過標準接口(如S3協議、HDFS API)提供給TensorFlow、PyTorch等框架進行模型訓練,避免了數據在不同系統間遷移的麻煩。

- 對數據治理與安全的支撐:統一的權限模型(如基于AWS IAM或Ranger的細粒度訪問控制)、審計日志和加密機制,確保所有數據處理操作都在受控的安全環境下進行。

四、 實踐挑戰與展望

實踐中,構建和管理億級數據湖仍需應對諸多挑戰:小文件問題導致的性能下降、跨地域數據訪問的延遲、不斷攀升的存儲成本控制、以及日益嚴格的數據合規要求。未來的技術實踐將更側重于:

- 自動化與智能化:利用AI進行數據自動分類、優化建議(如自動分區、壓縮)、異常檢測和成本管理。

- 湖倉一體演進:在數據湖的靈活性與數據倉庫的性能與治理之間取得更好平衡,提供統一的數據體驗。

- 跨云與混合云部署:滿足企業多云戰略,實現數據與計算在異構環境下的無縫流動與管理。

****

億級數據湖的統一存儲實踐,絕非僅僅是堆積海量存儲空間。它是一個以統一、高效、安全的存儲層為核心,通過先進的元數據管理、表格式和存儲優化技術,向上層多樣化的數據處理范式提供標準化、高性能支持服務的系統性工程。成功的實踐將使數據湖真正成為企業匯聚數據資產、挖掘數據價值的堅實基石,賦能業務創新與智能決策。

如若轉載,請注明出處:http://m.datuya.cn/product/65.html

更新時間:2026-04-06 23:17:25